马斯克Grok-1.5震撼发布:数学编码飞跃,128k上下文全绿精准!

Grok-1.5:解锁AI长上下文理解与数学能力的新纪元

在人工智能的浪潮中,每一次技术的飞跃都如同在深海中投下了一枚石子,激起层层涟漪。近日,马斯克旗下的xAI公司推出的Grok-1.5大模型,就是这样一个令人瞩目的技术突破。这款新版本的大模型不仅将长上下文理解能力推向了新的高度,还在数学能力上取得了惊人的提升,让我们一同探索Grok-1.5带来的技术奇迹。

在传统的大模型中,上下文长度的限制一直是制约模型性能的重要因素。Grok-1.5打破了这一限制,将上下文长度从原先的8192提升至惊人的128K,与GPT-4持平。这一升级意味着Grok-1.5能够处理更长、更复杂的文本信息,为复杂任务提供了更深入的理解。

想象一下,当我们与AI进行对话时,如果AI能够记住我们之前的对话内容,并基于这些内容进行推理和回答,那么我们的交流将变得更加流畅和自然。这正是Grok-1.5所实现的长上下文理解能力的魅力所在。它不仅能够处理简单的对话,还能在处理长文档、法律文件、学术论文等复杂文本时,展现出卓越的性能。

除了长上下文理解能力外,Grok-1.5在数学能力上也取得了令人瞩目的进步。在HumanEval数据集上的测试中,Grok-1.5的得分甚至超过了GPT-4,展现出了其强大的数学推理能力。这一提升不仅体现在简单的数学运算上,更在解决复杂数学问题时发挥了关键作用。

在MATH和G**8K这两个涵盖从小学到高中竞赛题目的数学基准测试中,Grok-1.5分别取得了50.6%和90%的成绩。这些成绩不仅证明了Grok-1.5在数学问题上的强大处理能力,更体现了其在理解和解决复杂问题上的潜力。想象一下,当AI能够处理复杂的数学问题,甚至在某些方面超越人类时,它将为我们的教育、科研等领域带来怎样的变革?

除了数学能力外,Grok-1.5在推理和解决问题能力上也取得了显著提升。这一提升不仅体现在处理文本信息上,更在理解和解决复杂问题时发挥了关键作用。

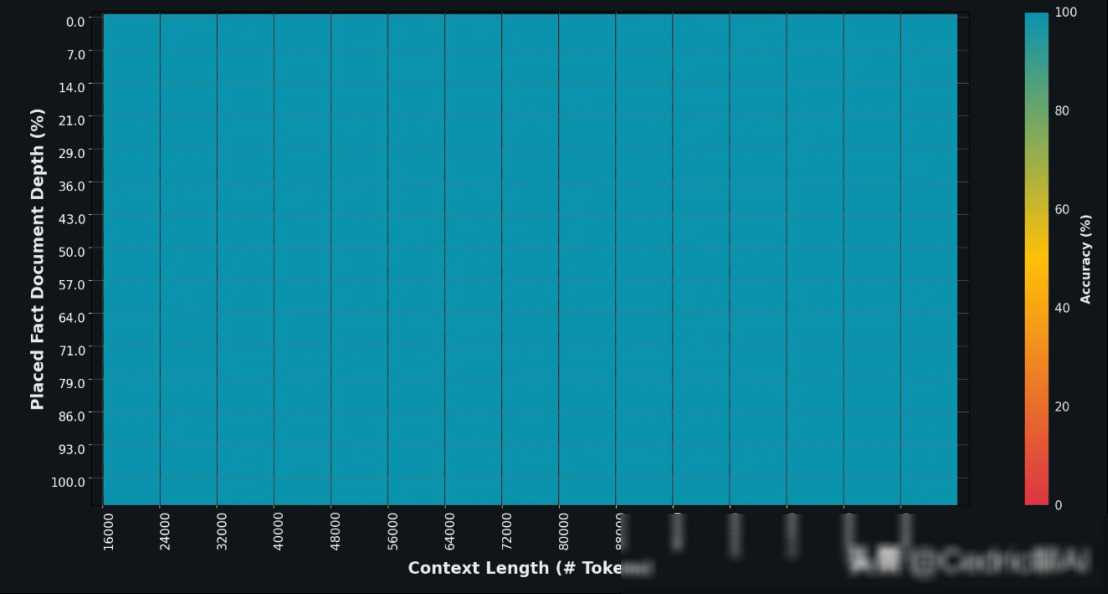

以“大海捞针”(Needle In A Haystack, NIAH)评估为例,Grok-1.5在处理长达128K token的上下文中进行文本嵌入和检索时,实现了100%的检索准确度。这一成绩不仅标志着Grok-1.5在理解和处理长篇文档方面的卓越性能,更预示着其在学术研究、法律文档审查、数据分析等领域的巨大应用潜力。

Grok-1.5的背后,是xAI公司搭建的一套强大而灵活的基础设施。这一基础设施采用了基于JAX、Rust和Kubernetes的自定义分布式训练框架,使得开发团队能够以较小的努力快速构建出新的想法原型,并进行大规模训练。这种独特的技术选型不仅避开了常规的Python语言和PyTorch框架,更展示了Grok系列在技术实现上的创新。

为了应对大规模GPU集群上训练大型语言模型(LLM)的挑战,xAI团队特别设计了一种自定义的训练协调器。这个协调器能够自动侦测并剔除出现问题的节点,有效提升了训练作业的可靠性和持续运行时间。此外,通过优化检查点、数据加载和训练任务重启的流程,团队最大限度地减少了因故障导致的停机时间,这些措施共同保障了Grok-1.5开发过程的高效和稳定。

Grok-1.5的发布无疑为人工智能领域带来了新的机遇和挑战。在学术研究方面,它可以帮助研究人员处理和分析大量的文本数据,加速科研进程;在法律文档审查领域,它可以帮助律师快速准确地识别关键信息,提高工作效率;在数据分析领域,它可以帮助企业从海量数据中提取有价值的信息,为决策提供有力支持。

此外,Grok-1.5的推出也将对软件开发领域产生深远的影响。随着AI技术的不断发展,越来越多的开发者开始将AI技术应用于软件开发中,以提高软件的质量和效率。Grok-1.5的强大能力将为开发者提供更多的可能性,帮助他们构建出更加智能、高效的软件系统。

Grok-1.5的发布是人工智能领域的一次重要突破,它不仅展示了xAI公司在技术实现上的创新能力,更为我们揭示了AI技术的巨大潜力和无限可能。随着技术的不断进步和应用场景的不断拓展,相信AI技术将在未来发挥更加重要的作用,为我们带来更多的便利和惊喜。

作为一位软件工程的专业人士,我深感荣幸能够见证这一历史性的时刻。我也期待未来能够有更多像Grok-1.5这样的技术突破出现,推动人工智能领域的不断发展壮大。让我们共同期待AI技术的美好未来!