深度神经网络架构大揭秘,图解来袭!

深度神经网络架构的可视化艺术

在深度学习的世界里,神经网络架构是撑起整片天空的重要支柱。不过,要真正掌握和理解这些复杂的网络架构,光靠看一行行的代码是不够的。这就好比是在探索一个巨大的迷宫,可视化就是我们手中的地图,让我们能够更直观地理解这个迷宫的结构和布局。

想象一下,你正在面对一个由数百万个神经元和连接组成的神经网络。每个神经元都是一个处理单元,它们通过连接(权重)相互传递信息。在这个巨大的网络中,信息的流动、处理、传递,形成了一个复杂的计算图。如果没有合适的可视化工具,我们很难直观地理解这个计算图是如何工作的。

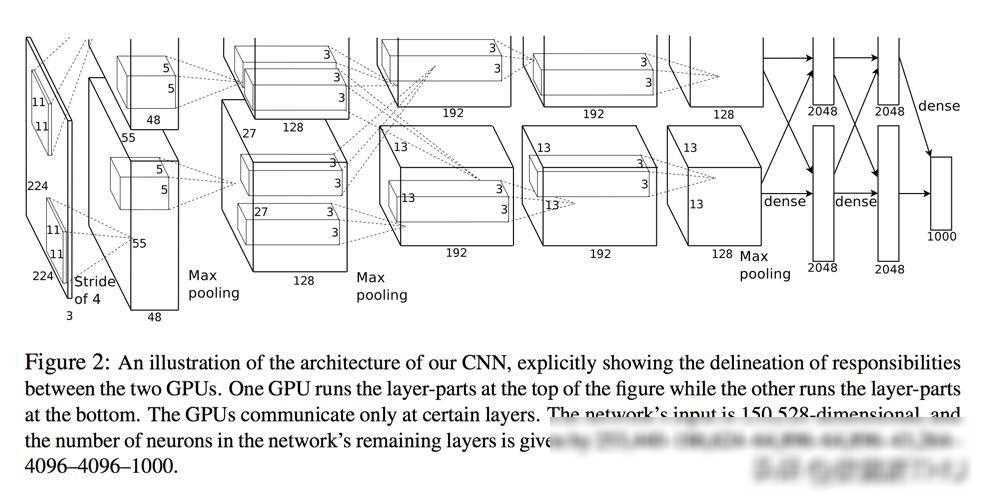

AlexNet,这个在深度学习历史上具有里程碑意义的架构,让我们看到了卷积神经网络(CNN)在处理大型图像分类任务时的巨大潜力。当我们仔细研究AlexNet的论文时,会发现其中的图示并不完整,甚至有些难以理解。这不禁让我们思考:为什么如此重要的学术论文,在可视化方面却做得不够好?

答案可能在于,长期以来,深度学习领域的研究者们更关注于算法的创新和性能的提升,而相对忽视了可视化这一重要的交流工具。但是,随着深度学习技术的不断发展,我们越来越意识到,可视化不仅是理解网络架构的关键,更是推动技术发展的重要动力。

通过可视化,我们可以更直观地看到网络中的每一层是如何工作的,每个神经元是如何处理信息的。这种直观的理解,有助于我们更好地把握网络的整体结构和功能,从而更深入地理解深度学习的本质。

在开发新的神经网络架构时,难免会遇到各种问题。通过可视化,我们可以快速定位问题所在,找出网络中的“瓶颈”和“短板”,从而有针对性地进行优化和改进。

可视化不仅可以帮助我们理解现有的网络架构,还可以激发我们的创新思维。通过观察和分析不同的网络结构,我们可以发现其中的规律和趋势,从而提出新的网络架构和设计思路。

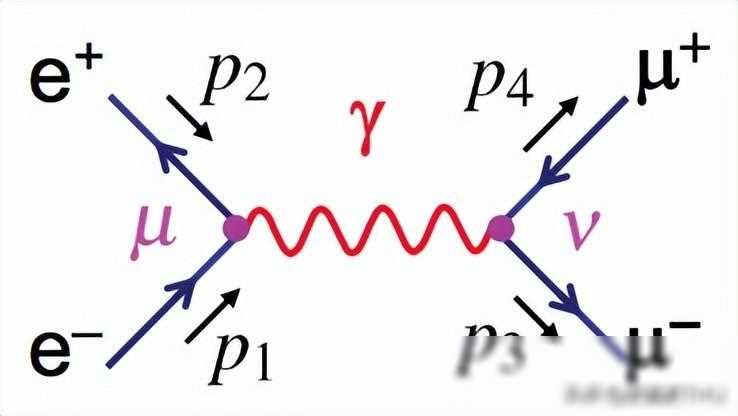

在神经网络中,层与层之间的连接是信息传递的关键。通过可视化,我们可以清晰地看到每一层之间的连接方式和权重分布。这有助于我们理解网络中的信息是如何逐层传递和处理的。

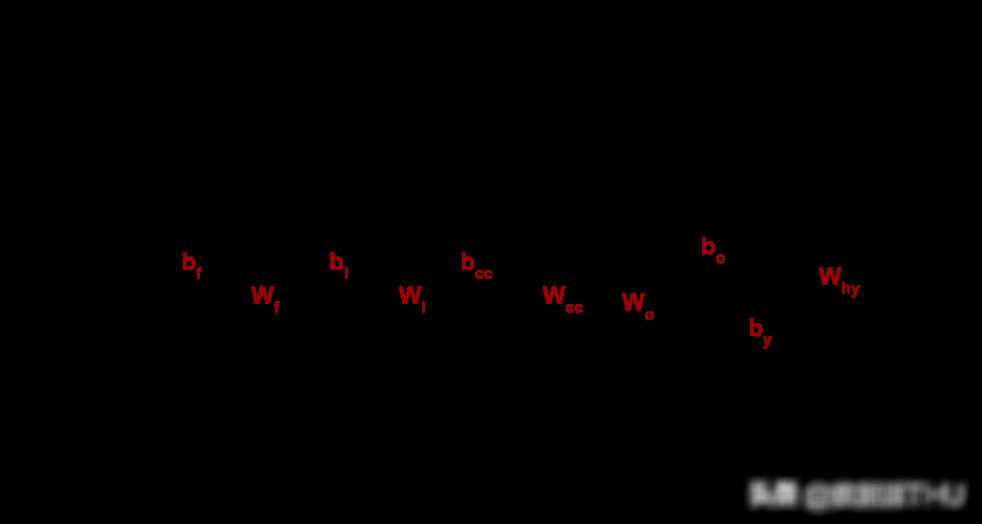

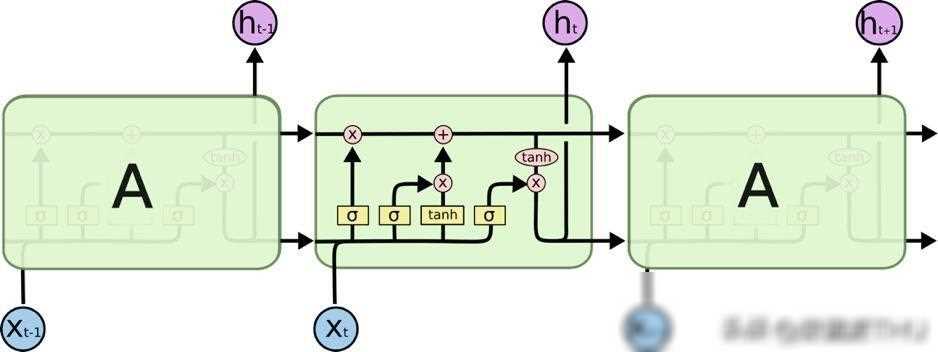

LSTM(长短期记忆网络)是一种特殊的循环神经网络,它在处理序列数据方面有着出色的表现。通过可视化LSTM的内部结构和工作原理,我们可以更深入地理解它是如何处理序列数据的,以及它是如何克服传统循环神经网络中的梯度消失和梯度爆炸问题的。

在复杂的神经网络中,通常会包含许多复合模块,如Inception模块、ResNet模块等。这些模块由多个子模块组成,具有特定的功能和结构。通过可视化这些复合模块的内部结构和工作原理,我们可以更好地理解它们在网络中的作用和贡献。

TensorBoard是TensorFlow提供的一个强大的可视化工具,它可以展示神经网络的结构、训练过程中的各种指标(如损失函数、准确率等)以及数据分布等信息。通过TensorBoard,我们可以实时监控网络的训练过程,从而及时发现问题并进行优化。

Netron是一个跨平台的神经网络可视化工具,它支持多种深度学习框架(如TensorFlow、PyTorch等)的模型文件。通过Netron,我们可以直观地看到模型的计算图、每一层的参数和输出等信息。这有助于我们更好地理解模型的结构和功能。

除了上述的可视化工具外,我们还可以从学术论文和在线资源中获取大量的可视化素材和灵感。例如,许多优秀的学术论文都会包含详细的网络架构图和可视化示例,这些资源可以帮助我们更好地理解和掌握深度学习技术。

神经网络架构的可视化是深度学习中不可或缺的一部分。通过可视化,我们可以更直观地理解网络的结构和功能,从而更深入地掌握深度学习的本质。可视化也是推动深度学习技术发展的重要动力之一。因此,我们应该重视可视化在深度学习中的应用和实践,不断探索新的可视化技术和方法,为深度学习领域的发展贡献自己的力量。