揭秘关系抽取:预测句子中实体的关系与属性!

深入探索:基于深度残差学习的弱监督关系抽取

在如今的大数据时代,信息如潮水般涌来,如何从中提取有价值的知识,成为了我们面临的挑战。关系抽取,作为自然语言处理(NLP)领域的一项重要技术,旨在从文本中识别出实体之间的关系,为知识图谱的构建、问答系统、情感分析等领域提供了重要支撑。关系抽取任务往往面临着缺乏大量标注数据的难题,这使得传统的监督学习方法难以奏效。今天,我们就来聊聊如何通过深度残差学习来解决弱监督关系抽取的问题。

一、关系抽取的挑战与机遇

关系抽取的核心任务是从文本中识别出两个或多个实体之间的语义关系。这种关系可能是某种属性、分类或者事件。例如,在句子“Steve Jobs is the founder of Apple”中,实体“Steve Jobs”和“Apple”之间的关系就是“founder”。关系抽取在构建知识图谱、实现智能问答等方面发挥着至关重要的作用。由于标注数据的缺乏,传统的监督学习方法在关系抽取任务上往往表现不佳。

幸运的是,远程监督方法为我们提供了一条新的思路。它利用已有的知识库事实,对无标签的文本数据进行标注,从而大大扩充了训练数据集。远程监督方法也面临着数据噪声的问题,即标注的数据中可能包含一些错误或者不准确的信息。这就需要我们设计出更加鲁棒的模型,来应对这种噪声输入。

二、深度残差学习的魅力

深度残差学习是一种近年来兴起的神经网络架构,它通过引入残差连接,使得网络能够学习更深层次的特征表示。在图像识别、语音识别等领域,深度残差学习已经取得了显著的成果。那么,在关系抽取任务中,深度残差学习又能带来哪些新的可能性呢?

深度残差学习能够解决梯度消失的问题。在训练深度神经网络时,由于反向传播过程中梯度的逐层衰减,往往会导致网络无法有效地学习到深层次的特征。而残差连接可以将低层次的特征直接传递到高层次,从而避免了梯度的衰减,使得网络能够学习到更加丰富的特征表示。

深度残差学习可以提高模型的鲁棒性。在关系抽取任务中,由于远程监督方法引入的噪声数据,模型往往需要具备更强的鲁棒性来应对这种挑战。而深度残差学习通过引入残差连接,使得模型在训练过程中能够更好地适应噪声数据,从而提高了模型的鲁棒性。

三、基于深度残差学习的弱监督关系抽取模型

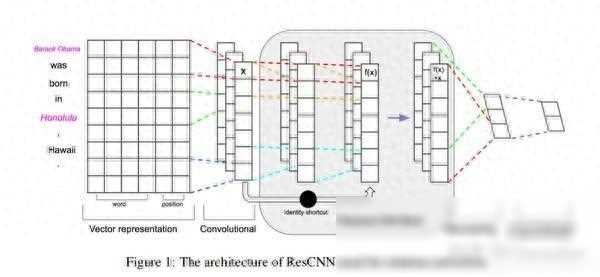

为了将深度残差学习应用于弱监督关系抽取任务中,我们设计了一个基于深度残差学习的CNN模型。该模型主要由以下几个部分组成:

向量表示层:将文本中的每个词组表示为一个向量,包括词向量和位置向量两部分。其中,词向量通过预训练的词嵌入模型得到,而位置向量则用于表示当前词组与两个目标实体之间的相对距离。

卷积层:通过卷积操作提取文本中的局部特征。我们采用了多种不同大小的卷积核来捕捉不同长度的特征模式。

残差卷积块:在卷积层的基础上,我们引入了残差连接,构建了一个残差卷积块。该块由两个卷积层和一个ReLU激活函数组成,通过残差连接将低层次的特征直接传递到高层次,避免了梯度的衰减。

最大池化层:对残差卷积块的输出进行最大池化操作,以获取文本的全局特征表示。

输出层:通过一个全连接层和一个softmax函数,输出实体之间的关系概率分布。

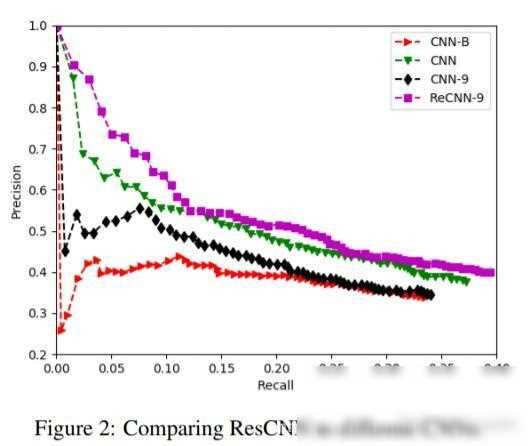

为了验证模型的有效性,我们在多个公开的数据集上进行了实验。实验结果表明,我们的模型在弱监督关系抽取任务上取得了显著的效果提升,不仅在准确率上超过了其他基于CNN的模型,而且在处理噪声数据方面也表现出了更强的鲁棒性。

四、未来展望

虽然我们的模型在弱监督关系抽取任务上取得了不错的效果,但仍有一些值得进一步探索的问题。例如,如何进一步优化模型的架构,提高模型的性能;如何结合更多的外部知识库信息,提高模型的标注质量;如何将模型应用于更广泛的NLP任务中,等等。我们相信,随着技术的不断发展,这些问题都将得到更好的解决。

总之,基于深度残差学习的弱监督关系抽取模型为我们提供了一种新的思路来解决关系抽取任务中的挑战。通过引入残差连接和深度神经网络架构,我们的模型能够学习到更加丰富的特征表示,并在处理噪声数据方面表现出了更强的鲁棒性。未来,我们将继续探索和优化该模型,为NLP领域的发展贡献更多的力量。